En las guerras de esta nueva era no solo circulan misiles, también circulan imágenes, rumores, montajes y narrativas diseñadas para sembrar miedo, indignación o confusión. Eso es justamente lo que muestra una de nuestras investigaciones más recientes sobre desinformación en torno al conflicto relacionado con Irán.

En los primeros días de la escalada informativa, las redes sociales se llenaron nuevamente de videos viejos presentados como actuales, imágenes generadas con inteligencia artificial (IA) difundidas como si fueran evidencia y escenas reales sacadas de contexto para hacerlas encajar en una historia falsa. El patrón es claro. En tiempos de crisis, la mentira visual viaja rápido y suele presentarse con apariencia de prueba (Wardle & Derakhshan, 2017).

Monitoreo y verificación de la información difundida

En nuestro ejercicio de investigación analizamos una muestra correspondiente al periodo del 28 de febrero al 6 de marzo de 2026 y encontramos tres mecanismos dominantes de desinformación.

El primero fue el reciclaje de videos y fotografías antiguas, publicados de nuevo como si documentaran hechos recientes. El segundo, la circulación de contenido sintético creado con IA: supuestos bombardeos, escenas urbanas destruidas, imágenes de cadáveres y videos “captados sobre el terreno” que en realidad no eran registros auténticos. El tercero fue el reetiquetado geográfico, una táctica sencilla pero muy eficaz: tomar una explosión ocurrida en otro país o en otro momento y presentarla como si hubiera sucedido en el centro mismo del conflicto (Wardle & Derakhshan, 2017).

Uno de los aspectos más inquietantes que revela nuestra investigación es que la desinformación no depende solo de textos engañosos, sino de imágenes manipuladas. Cuando una imagen parece real, mucha gente la interpreta como prueba concluyente. Ahí radica gran parte del problema. Reuters documentó, por ejemplo, una imagen que mostraba supuestamente el cuerpo de Ali Khamenei atrapado entre escombros; el análisis concluyó que se trataba de contenido generado con IA, identificado con muy alta confianza por herramientas de detección asociadas a SynthID (Reuters Fact Check, 2026).

AFP verificó otro caso, un video que mostraba supuestas tropas estadounidenses ya dentro de Irán. El material presentaba inconsistencias visuales y fue clasificado como producción sintética; además, no existían reportes oficiales que confirmaran, en ese momento, la presencia de tropas terrestres de Estados Unidos en ese territorio (AFP Fact Check, 2026a).

Manipulación sintética con IA

No se trata de casos aislados. En nuestro análisis encontramos ejemplos de videos que aseguraban mostrar ataques iraníes contundentes sobre Tel Aviv, pero que en realidad tenían señales de generación artificial, como banderas deformadas, automóviles inconsistentes o patrones repetidos dentro del encuadre.

Maldita.es detectó varios de estos materiales y advirtió que, aunque a simple vista podían parecer registros auténticos, presentaban rasgos muy típicos del contenido sintético (Maldita.es, 2026a, 2026b). FactNameh, por su parte, documentó la difusión de videos falsos que supuestamente mostraban la destrucción de ciudades israelíes, cuando en realidad algunos eran generados con IA y otros eran materiales antiguos reutilizados, incluso de desastres ocurridos en otros países (FactNameh, 2026a, 2026b).

La desinformación en situaciones de guerra “funciona” (para alguna de las partes involucradas) porque mezcla velocidad, emoción y verosimilitud. Un video de una explosión no necesita ser verdadero para volverse viral; le basta con parecer plausible y llegar en el momento exacto en que la audiencia está buscando explicaciones urgentes.

En el monitoreo realizado encontramos que en los primeros días del conflicto se concentró el mayor volumen de reciclaje de materiales y piezas engañosas, lo cual coincide con la lógica de saturación informativa típica en escenarios de crisis (Silverman, 2014). El desorden informativo no aparece después, aparece desde el inicio, casi al mismo tiempo que los hechos.

Frente a este panorama, los medios institucionales necesitan fortalecer sus capacidades de monitoreo y verificación si realmente buscan convertirse en fuentes confiables en contextos de alta incertidumbre.

En situaciones como un conflicto internacional, la confianza no se gana solo publicando información, sino demostrando que existe un método riguroso para detectarla, contrastarla y explicarla con rapidez. De ahí la relevancia de construir sistemas de monitoreo bilingües, en español y persa, capaces de detectar, traducir, clasificar y verificar narrativas falsas antes de que se consoliden. Para este caso particular se deben considerar fuentes oficiales, verificadores profesionales, medios en persa y plataformas como X, Telegram, TikTok, Instagram, Facebook y YouTube. No basta con observar qué circula; se requiere seguir la ruta de cada contenido, identificar quién lo amplifica, cómo cambia entre idiomas y qué variantes narrativas adopta en su propagación (Wardle & Derakhshan, 2017).

¿Pueden modificar la percepción pública?

Los hallazgos de nuestro propio ejercicio de investigación muestran por qué esta tarea resulta indispensable. Por ejemplo, se localizó un video viral en TikTok que afirmaba que Irán había atacado una base militar estadounidense en Yibuti, cuando en realidad correspondía a una explosión en Port Sudan ocurrida en mayo de 2025. Encontramos que dicha pieza fue compartida más de 1,700 veces.

También circuló un video sobre una supuesta “explosión masiva en la embajada de EE. UU. en Riad”, amplificado por cuentas de gran visibilidad, aunque la geolocalización mostró que se trataba de una autopista situada a unos 25 kilómetros de la embajada y que el material ya circulaba desde semanas antes.

Casos así evidencian que la desinformación no solo confunde, incluso puede modificar la percepción pública del conflicto en tiempo real.

Un video falso sobre tropas en tierra puede instalar la idea de que la guerra escaló a una invasión directa; una imagen sintética del cadáver de un líder puede detonar miedo, indignación o deseos de represalia; y un clip mal ubicado sobre una embajada o una base militar puede intensificar tensiones diplomáticas y alimentar la sensación de ataque inminente.

La desinformación, por tanto, no se limita a distorsionar hechos; también empuja emociones, decisiones y narrativas públicas en momentos especialmente sensibles. Por eso, cuando los medios institucionales verifican con método, transparencia y consistencia, no solo corrigen falsedades, también ofrecen certidumbre, contexto y contención social.

Nuestro análisis deja una conclusión incómoda pero necesaria: hoy una guerra también se libra en el terreno de la percepción. La inteligencia artificial, los archivos reciclados y la circulación transnacional de contenido engañoso han vuelto mucho más difícil distinguir entre testimonio y simulación. Por eso, más que reaccionar caso por caso, los medios institucionales deben construir capacidades permanentes de monitoreo, alfabetización mediática y verificación multilingüe. La confianza pública depende cada vez más de esa infraestructura crítica.

Al final, la guerra de las pantallas no es una metáfora menor, es el nombre de un escenario en el que la disputa por la verdad ocurre al mismo tiempo que los hechos, en la pantalla del teléfono, en el video reenviado y en la imagen que parece prueba, aunque no lo sea (Wardle & Derakhshan, 2017).

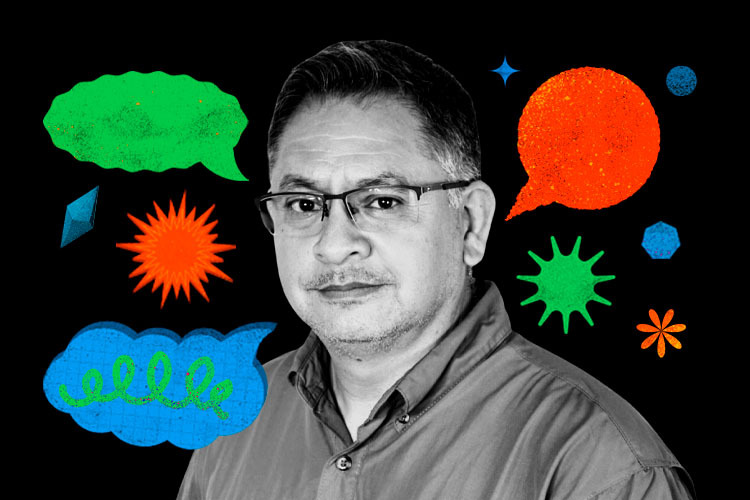

Autor

Fernando Ignacio Gutiérrez Cortés es Director de División de la Escuela de Humanidades y Educación del Tecnológico de Monterrey, Región CDMX. Es miembro del Sistema Nacional de Investigadores Nivel 1. Sus estudios se enfocan en la nueva ecología mediática en la era digital. Es Doctor en Diseño con especialidad en Visualización de la Información por la Universidad Autónoma Metropolitana.

Este artículo fue publicado originalmente en el Observatorio de Medios Digitales, de la Escuela de Humanidades y Educación del Tecnológico de Monterrey. Si quieres conocer el estudio completo, sus referencias y las piezas de desinformación documentadas en este análisis, visita este enlace.